Skalierbare Rechenleistung für ML, DL, Inferencing

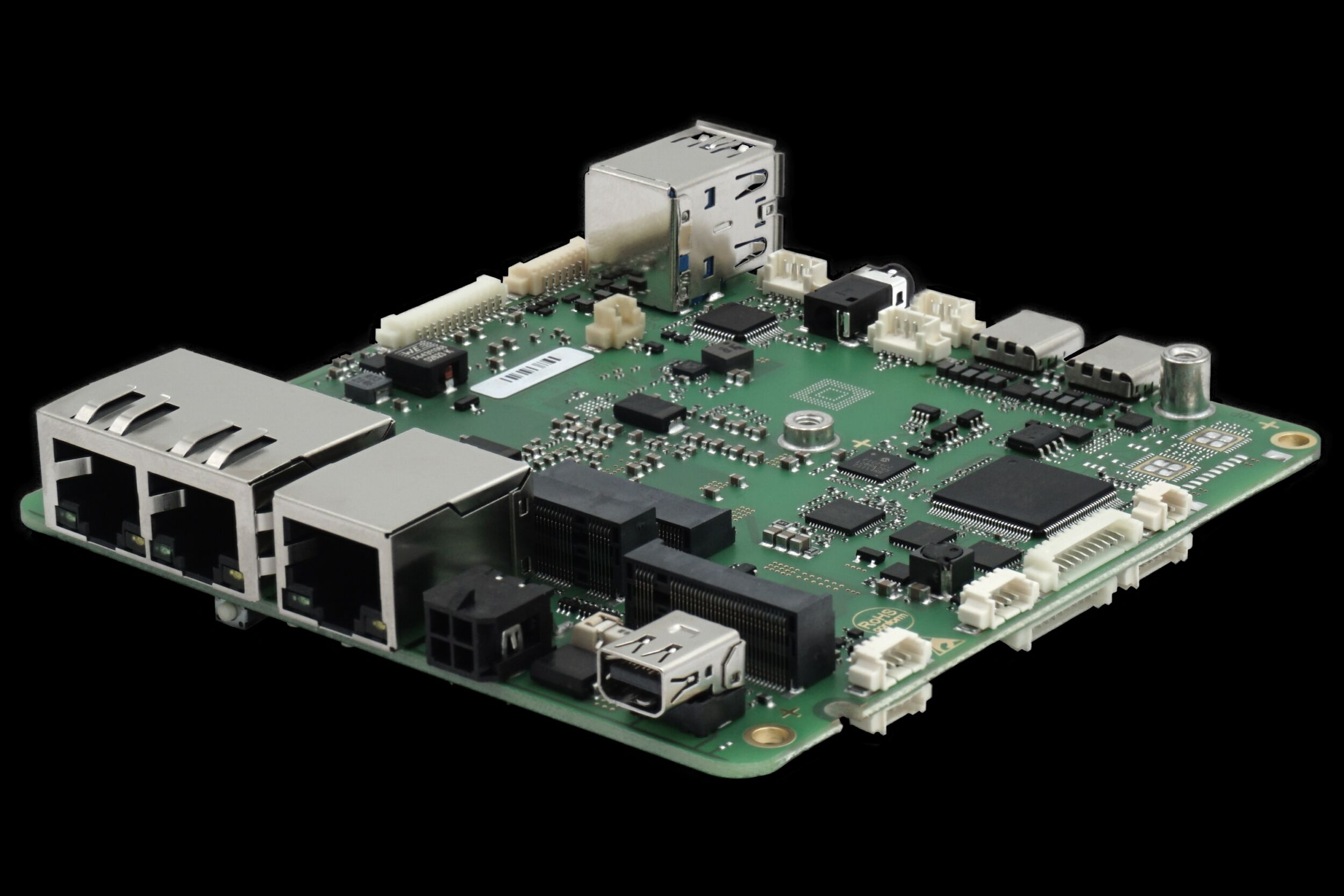

Mit einem geringen Geräuschpegel von max. 34dB(A) und EN55032 Klasse B Zertifizierung eignet sich das System neben dem Einsatz in industrieller Umgebung auch für den Wohn- und Geschäftsbereich. (Bild: Koantron S&T AG)

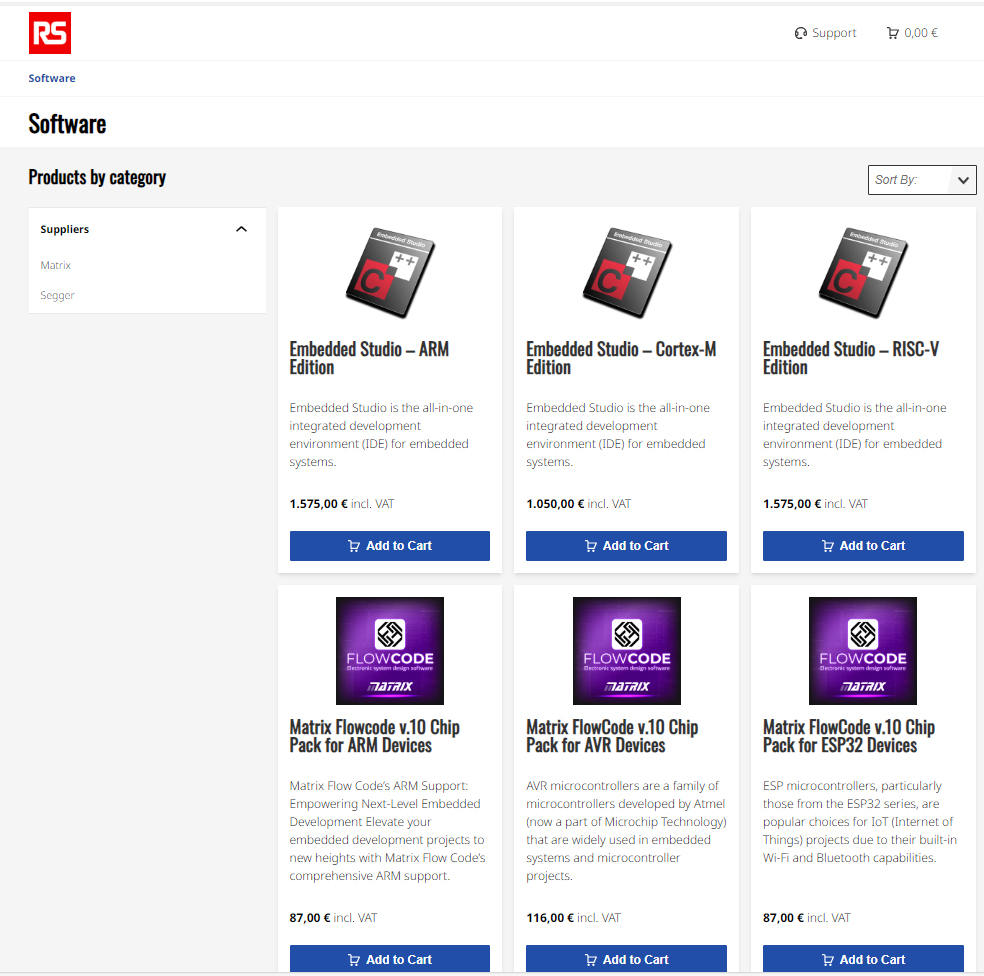

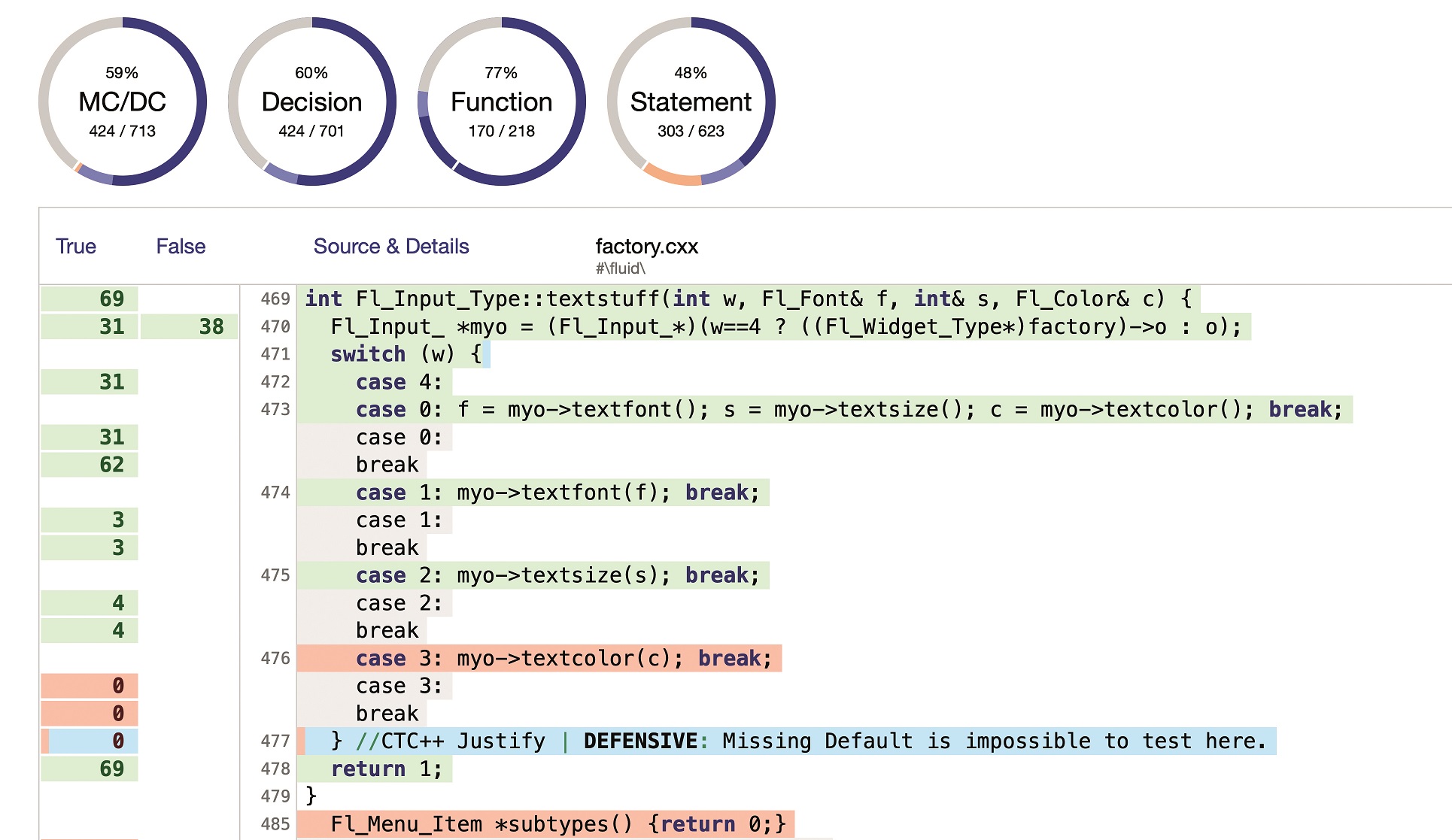

Damit KI-Lösungen, die auf Deep Learning, Machine Learning und Inferencing aufsetzen und ihre Rolle als systemkritische Anwendungen in jeder Branche erfüllen können, sind leistungsstarke Hard- und Software-Komponenten unabdingbar. Die Systeme müssen große Datenmengen in kurzer Zeit analysieren. Die Rechenpower, die für Parallel Processing notwendig ist, steuern Multicore-CPUs, Video Processing Units (VPUs), Graphics Processing Units (GPUs) oder Field Programmable Gate Arrays (FPGAs) bei, die neuronal Netze mit Rechenleistungen im Bereich von Tera-Operations pro Sekunde berechnen. Das von dem IIoT Software Framework Susietec unterstützte Intel OpenVino Video Processing API ermöglicht hierzu, einmal erstellte neuronale Netzwerk Modelle zu skalieren und wahlweise auf Intel Multicore CPUs, GPUs, VPUs und FPGAs auszuführen und somit exponentielle Leistungssteigerungen zu ermöglichen. Bestehende trainierte neurale Netzwerk Modelle können mit geringem Aufwand auch auf Intel OpenVino konvertiert werden. Neben Intel und NXP basierenden Plattformen für das Inferencing, setzt Kontron seit Juli 2019 als Nvidia Preferred Partner auch GPUs des internationalen Marktführers bei Grafikkarten und GPUs für das Deep Learning (Training) ein. Nvidia-GPUs sind Teil des aktuell leistungsfähigsten Kontron Rackmount-Server Kiss V3 4U SKX-AI. Der skalierbare Server ist mit zwei starken Prozessoren der Intel Xeon SP-Serie ausgestattet, die mit zwölf DIMM DDR4-2666 Modulen und bis zu 768GB RAM mit ECC-Unterstützung erweitert werden können. Bis zu drei doppeltbreite Highend GPU-Karten Nvidia Tesla V100 sorgen für eine extrem hohe GPU-Leistung. GPUs führen genau die Matrix-Mathematik durch, die neben dem Rendern auch für das Simulieren künstlicher Neuronen notwendig ist. Die Nvidia GPUs unterstützen dabei die Intel Xeon Prozessoren bei dem Trainieren neuronaler Netze. Für die Softwareentwicklung können Anwender das leistungsstarke Cuda Toolkit von Nvidia nutzen.

KI-Entwicklung mit oder ohne Cloud

„KI-Lösungen in die Cloud zu verlagern ist nicht immer die beste Wahl.“Stefan Eberhardt, Business Development Manager, Kontron Technologies (Bild: Kontron S&T AG)

Der konkrete Anwendungsfall entscheidet darüber, ob KI-Lösungen und -Prozesse zum Teil oder in Gänze in die Cloud verlagert werden. Das IIoT Software Framework Susietec von Kontron Technologies, vormals S&T Technologies, einem Schwesterunternehmen von Kontron innerhalb der S&T Gruppe, hat dabei eine zentrale Bedeutung, denn es ermöglicht die jeweilige IoT-Architektur hybrid und skalierbar zu realisieren. Susietec ist für den Einsatz mit Kontron Hardware optimiert, lässt sich aber nahtlos mit Produkten von Drittanbietern einsetzen und in die vorhandene Infrastruktur der Kunden integrieren. Susietec ist ein herstellerunabhängiges Software- und Dienstleistungsangebot, das alle Puzzleteile einer Cloudlösung zusammenfügt und zu einem anwenderspezifischen Gesamtpaket verbindet. In bestimmten Szenarien ist es nicht sinnvoll, KI-Lösungen in die Public Cloud zu verlagern. Wenn die Reaktionszeiten bei Millisekunden liegen müssen, sind Latenzzeiten und Bandbreitenbeschränkungen der Cloud nicht akzeptabel. Dann sind leistungsstarke Edge Computer oder eine Embedded Cloud, wie sie sich mit dem High Performance Server Kiss 4U V3 SKX am Netzwerkrand aufbauen lässt, notwendig. In diesem Fall hat Susietec die Aufgabe, Daten lokal vorzuverarbeiten, zu filtern und danach in die Cloud weiterzuleiten.