Hohe Auflösungen integriert

Der Bildsensor verwendet acht Zeilen mit jeweils 2.048 Pixeln, die aus vier Zeilen mit 4×8µm-Pixeln und vier Zeilen mit 4×4µm-Pixeln bestehen. Der Container aus großen Pixeln sorgt für eine hohe Empfindlichkeit, während die kleinen Pixel ein feines Signal mit einer effektiven Auflösung von bis zu 8.192 Pixel bei geringer Verlustleistung und kompakter Größe liefern können. Der Sensor verfügt über eine konfigurierbare synchronisierte 10 bis 12Bit Parallelausgangsschnittstelle sowie eine proprietäre und I2 C-Schnittstellen. Darüber hinaus verfügt der Sensor über ein CDS zur Rauschunterdrückung bei festen Mustern, Umgebungslicht-Subtraktion sowie über einen Onboard-Testmodus. Das optimiert die Erfassung von Messwerten und führt zu deutlich besseren Analysen. Anwendungsbereiche für den Sensor liegen im Bereich von Machine-Vision-Applikationen, wie Roboter-LiDAR, Barcodeleser, Industrie 4.0 und Automotive. Die hohe Zahl der Pixel ermöglicht eine detailreiche Auflösung von Messwerten. Der Bildsensor unterstützt programmierbare Übertragungsgeschwindigkeiten mit einer hohen Bildrate und liefert zudem eine automatische Belichtungssteuerung. Damit wird bei nahen Objekten eine Sättigung vermieden, während sich die Empfindlichkeit gegenüber entfernten Objekten erhöht. Auf diese Weise lassen sich realitätsnahe und praxisorientierte Werte in einem breiten Radius ermitteln. Die automatische Spitzenerkennung für die Triangulation und die Konfiguration pro Bild ermöglicht zudem eine spontane Reaktion auf Ereignisse.

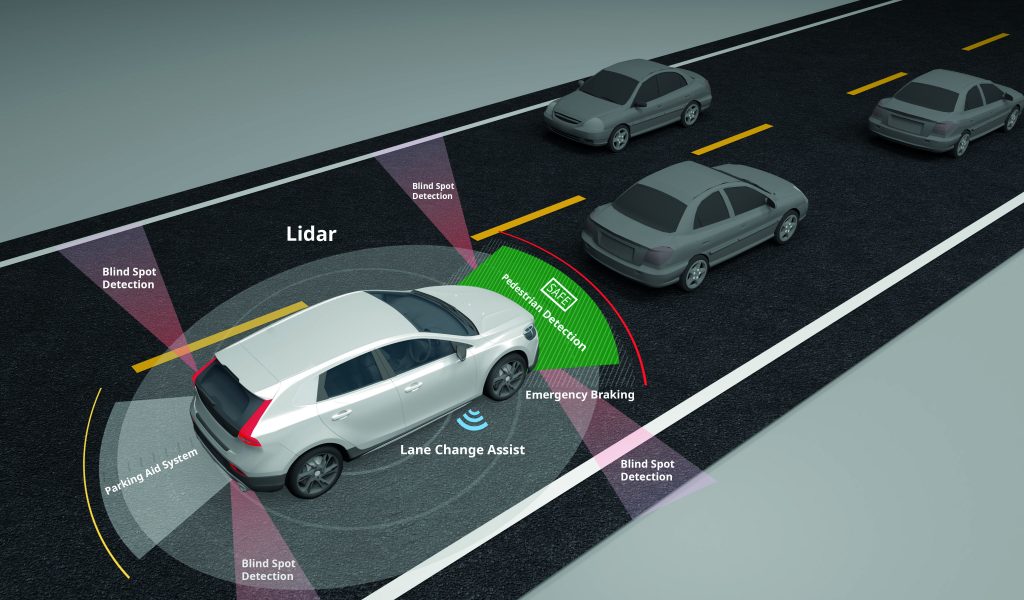

Kostengünstig in volumenstarke Märkte gehen

„Mit den Bildsensoren können Unternehmen kosteneffiziente Lösungen für volumenstarke und wettbewerbsintensive Märkte entwickeln“, charakterisiert Eduard Schäfer. Durch den geringen Stromverbrauch sei er auch gut für wieder aufladbare und batteriebetriebene Produkte geeignet. Unitronic sieht den NSI3100 auch im Einsatz, wenn hohe Leistungen gefragt sind, beispielsweise wenn intensive Algorithmen und Berechnungen gefordert werden. Die Technologie kombiniert auf einem Chip digitale Verarbeitung mit analogen Einheiten. „Als Zielmärkte für unsere CMOS-Line-Image Sensoren sehen wir z.B. visuelle Sicherheitslösungen bei LiDAR-Anwendungen für die Automobilindustrie, denn sie bieten auf einer Plattform hohe Empfindlichkeit, Leistung und Genauigkeit“, sagt Eduard Schäfer. So unterstützt eine Hinderniserkennung den Fahrer, um den notwendigen Abstand einzuhalten. Der Sensor bietet die Möglichkeit, den individuell gewünschten Abstand zu den Fahrzeugen vor oder hinter einem Objekt einzustellen. Wird der vorgegebene Wert überschritten, erhält der Lenker automatisch visuelle Informationen des Bordcomputers. Diese Technologie wird in aktiven und passiven Fahrzeugsicherheitssystemen verwendet, die Kameras für die Abstandsmessung einsetzen. Aufgrund der höheren Auflösung, ist eine bessere Objekterkennung möglich und wird auch Rückfahrverbesserung, Nachtsicht und Spurhaltemeldung optimieren.

Reinigungsroboter und Drohnen im Einsatz

Die intelligente Haushaltshelfer arbeiten ebenfalls mit Bildsensortechnologien. Das ermöglicht die präzise Erkennung von Hindernissen und erlaubt es beispielsweise dem Saugroboter, bestimmte Objekte bei seinem Reinigungsprozess zu umfahren. Auch Flugdrohnen, die etwa für die Erstellung einer Echtzeitgeländekarte verwendet werden, profitieren durch die hochauflösenden Bilder dank der CMOS-Sensoren.

LiDAR – was steckt dahinter?

LiDAR steht für ‚Light Detection And Ranging‘. Dabei handelt es sich um ein optisches Messverfahren zur Ortung und Messung der Entfernung von Objekten. Im Prinzip ähnelt es dem Radarverfahren. Allerdings werden bei LiDAR anstelle von Mikrowellen Ultraviolett-, Infrarot- oder Laserstrahlen des sichtbaren Lichts (daher LiDAR) verwendet. Die Methode wird zur optischen Abstands- und Geschwindigkeitsmessung, aber auch zur Fernmessung atmosphärischer Parameter verwendet. Die Systeme senden Laserimpulse aus und detektieren das zurückgestreute Licht. Aus der Lichtlaufzeit der Signale wird die Entfernung zum Ort der Streuung berechnet. Wolken- und Staubteilchen in der Luft (Aerosole) streuen das Laserlicht und ermöglichen eine hochauflösende Detektion und Entfernungsmessung. Je nach Wellenlänge des verwendeten Laserlichts sind LiDAR-Systeme mehr oder weniger empfindlich für molekulare oder Partikelrückstreuung. Die Stärke der Rückstreuung bei einer Wellenlänge hängt von der jeweiligen Partikelgröße und Konzentration ab. Mit LiDAR-Systemen, die mehrere Wellenlängen nutzen, kann daher die genaue Größenverteilung der atmosphärischen Partikel bestimmt werden.